Il sito di news Gizmodo riporta, in un articolo uscito ieri, la notizia che Facebook influenzerebbe con scelte aziendali i cosiddetti “trends”, cioè gli argomenti maggiormente trattati dagli utenti del social-network più usato del mondo.

Le fonti citate da Gizmodo sono proprio gli ex responsabili della sezione “trending topics” (d’ora in poi TT) di Facebook. Ma cos’è la sezione TT? Letteralmente: “argomenti di tendenza”, è una funzione lanciata da Facebook nel 2014 che costituisce uno degli strumenti più potenti sul web in merito alla diffusione di notizie e aiuta, di fatto, a influenzare in modo consistente cosa leggeranno gli utenti di Facebook. Si tratta di ben 1,65 miliardi di utenti attivi mensilmente stando a una nota firmata dal CEO Mark Zuckerberg lo scorso 27 aprile. Quasi trecento milioni in più degli abitanti della Cina, lo stato più popoloso al mondo.

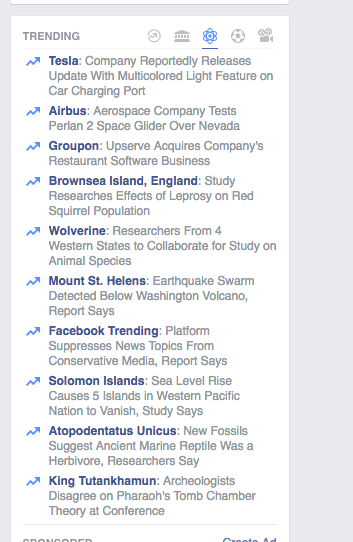

Nello specifico, stando alle fonti di Gizmodo, la sezione TT è stata falsata in modo sistematico. Si tratterebbe di vere e proprie scelte aziendali, simili a quelle che diamo per scontate nel giornalismo. Questioni di linea editoriale, quindi di opinione personale. Le notizie “conservatrici” sono state sistematicamente escluse, impedendo a nomi come Mitt Romney, Rand Paul, e ad altri contenuti di destra di apparire nella sezione TT e raggiungere quindi maggiore diffusione. Inoltre le notizie riguardanti lo stesso Facebook sono state anch’esse escluse, in quella che sarebbe una sorta di protezione aziendalista a scapito della veridicità della stessa funzione TT. Una funzione che, per come viene presentata, dovrebbe essere invece solo un algoritmo utile a conoscere in tempo reale gli argomenti più in voga tra gli utenti, proprio come lo era originariamente su Twitter.

Tra le notizie escluse sistematicamente ci sarebbero: Lois Lerner, procuratrice coinvolta nello scandalo dei favoritismi politici da parte del IRS (Internal Revenue Service) accusato di sfavorire gruppi politici conservatori; il governatore del Wisconsin e il sito di news molto popolare tra i conservatori Drudge Report.

Altri contenuti, come per esempio quelli riguardanti “Black lives matter” – lo slogan delle proteste contro le violenze da parte delle forze dell’ordine statunitensi verso la comunità afroamericana –, sono stati invece inseriti nelle liste degli argomenti di tendenza in modo “artificiale” così da implementarne la diffusione nonostante non fossero diffuse abbastanza da esservi incluse. Addirittura, in altri casi, sarebbero stati inseriti nelle liste argomenti che non godevano di nessuna particolare diffusione.

Lo stesso Gizmodo la scorsa settimana aveva scritto proprio di come chi si occupa della sezione TT di Facebook abbia libero accesso alle liste di argomenti di tendenza sul social network. Argomenti selezionati da un algoritmo ma in mano ai giornalisti impegnati a scrivere dei sunti per ogni topic includendo un link alla fonte. Stando alle esternazioni dei dipendenti di Facebook citati da Gizmodo, la selezione sarebbe però falsata anche in questo aspetto: le notizie di tendenza avrebbero il “permesso” di divenire tali soltanto a seguito della copertura di giganti quali la BBC, il New York Times, la CNN e così via. Le “notizie di destra” non sarebbero escluse completamente dai suggerimenti di Facebook, ma la prassi sarebbe di riportare alcuni argomenti solo se già ampiamente popolari.

Non ci sarebbero prove del fatto che i piani alti di Menlo Park sapessero dell’applicazione sistematica di questi filtri anti-conservatorismo e anti-destra, ma si descrive invece come certa l’influenza sui TT nel caso di argomenti di particolare interesse dei dirigenti. In questi casi la notizia verrebbe inserita tra le tendenze anche se non popolare tra gli utenti.

Ma come mai falsare sistematicamente uno strumento come quello delle liste di argomenti di tendenza? Come mai impegnarsi a manipolare qualcosa che un algoritmo crea automaticamente? Una risposta potrebbe essere quella della competizione tra Facebook e Twitter. Come si legge in questo pezzo Facebook ha faticato per competere con Twitter riguardo alla diffusione delle notizie e la manipolazione potrebbe essere stata uno dei passi fatti per vincere la sfida coi cinguettii. Un’altra spiegazione riguarderebbe il tentativo di proteggere e migliorare la reputazione di Facebook. Uno dei dipendenti intervistati ha infatti spiegato, con un esempio, le scelte che verrebbero prese nel modificare la sezione delle tendenze: «la gente ha smesso di preoccuparsi della Siria, e se questo non fosse stato un argomento di tendenza avrebbe leso l’immagine di Facebook».

Nel caso in cui lo scoop di Gizmodo venisse confermato si tratterebbe non solo di statistiche falsate sulle nostre bacheche, ma di molto di più. Alcuni dei TT “aiutati” da Facebook avrebbero visto poi una reale diffusione sui social network, fino ad arrivare alle prime posizioni degli argomenti di tendenza. Quindi staremmo parlando non solo di un’influenza operata attraverso scremature, scelte o selezioni, ma anche di un volontario e sistematico falsare la sezione TT attraverso inserimenti volontari dipingendo un mondo che non è mai esistito.

Poco tempo fa la questione della possibilità da parte di Facebook di influenzare elezioni e scelte politiche è stata posta da più parti. Sempre Gizmodo riportava il fatto che ogni settimana i dipendenti di Facebook rispondono a un sondaggio con cui decidono che domande porre alla dirigenza. Lo scorso 4 marzo in un gruppo Facebook privato utilizzato da dipendenti dell’azienda, sarebbe stato posto il quesito: «Quali responsabilità avrebbe Facebook nell’aiutare a prevenire l’elezione di Donald Trump nel 2017?».

Insomma, il potere dell’azienda fondata da Mark Zuckerberg potrebbe non apparire come qualcosa di nuovo, ma ora che si parla dei meccanismi che influenzerebbero sistematicamente l’opinione di più di un sesto della popolazione globale sembra quasi che la democrazia non stia reggendo alle prove di forza sottopostegli dai giganti del web – soprattutto di Facebook e del suo strapotere messo sempre meno in discussione dai concorrenti.

Nella storia recente ci sono stati vari episodi in cui governi e gruppi di potere hanno agito con lo scopo di influenzare l’opinione pubblica. Il caso delle censure imposte dal governo cinese ai motori di ricerca o quello del temporaneo oscuramento di Twitter durante le primavere arabe sono solo alcuni degli esempi che possono venirci in mente e, a voler allargare il cerchio, la propaganda politica è volta a ottenere lo stesso risultato: influenzarci. In casi come quello di Facebook però la differenza è una pericolosità insita nel segreto, nella menzogna, proprio come il presentare come neutrale qualcosa che non lo è. È su questa menzogna che si installa il complotto, che però come ricordava Umberto Eco ha una caratteristica fondamentale: se esiste prima o poi verrà scoperto.

Solo due anni fa, nel 2014, Facebook pubblicava i dati di un esperimento condotto su oltre 600mila utenti in cui si dimostrava l’influenza che il social network può avere sulle idee e le emozioni dei suoi utenti. L’esistenza di un esperimento del genere condotto su utenti ignari fece scandalo e arrivarono delle caute scuse dal gigante di Zuckerberg insieme alla promessa di seguire una nuova linea etica. Su Prismo, Pietro Minto, descrivendo proprio la possibilità di Facebook di manovrare un’elezione, scriveva: «Facebook non lo farà mai ma sappiamo che potrebbe farlo – e questo è già abbastanza». Oggi viene da pensare che forse c’è da preoccuparsi più di quanto non fosse immaginabile perché non solo Facebook potrebbe averlo appena fatto, ma viene da essere certi che, nel caso, la passerebbe liscia.

AGGIORNAMENTO: Techcrunch ha pubblicato la prima risposta di Facebook alle accuse di Gizmodo: «My team is responsible for Trending Topics, and I want to address today’s reports alleging that Facebook contractors manipulated Trending Topics to suppress stories of interest to conservatives. We take these reports extremely seriously, and have found no evidence that the anonymous allegations are true.»

Sulla questione è intervenuta una commissione permanente del senato USA:

US Senate Commerce Committee launches inquiry into Facebook’s news curation https://t.co/zUS0NvmAbF pic.twitter.com/RiVJNRt35u

— journalism festival (@journalismfest) 10 maggio 2016

Ed è arrivata anche una prima dichiarazione di Facebook:

Here’s Facebook’s latest statement in full. pic.twitter.com/11u1U8Ok9W

— Brian Stelter (@brianstelter) 10 maggio 2016